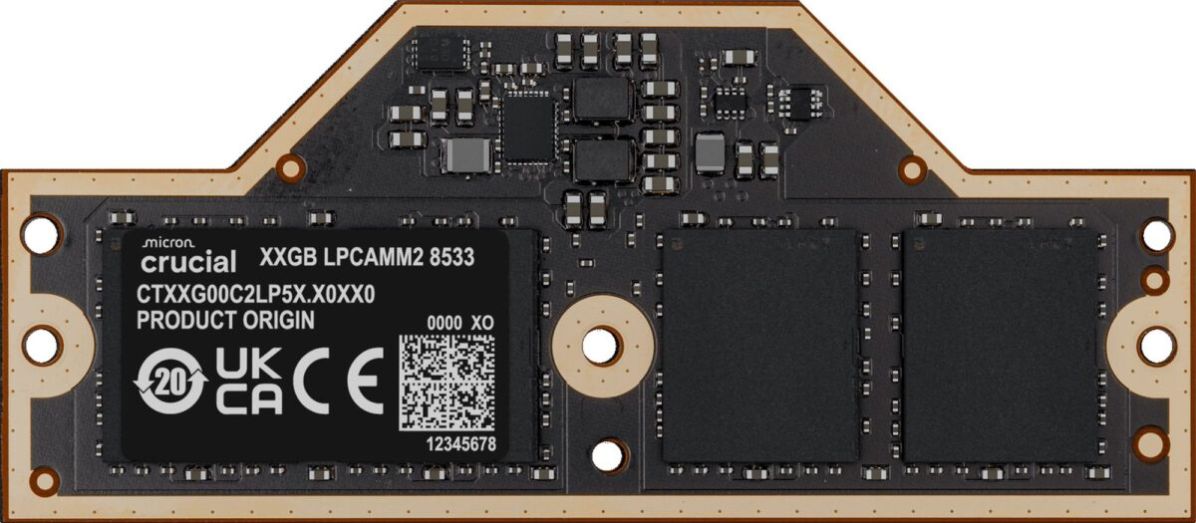

l'azienda ha annunciato il rilascio di moduli di memoria per notebook pc lpcamm2 con una frequenza effettiva fino a 8533 mt/s. questi moduli proprietari offrono prestazioni ad alta velocità per i notebook pc mantenendo al contempo dimensioni compatte.

secondo l'azienda, i moduli lpcamm2 dotati di chip lp-ddr5x riducono lo spazio occupato all'interno dei notebook pc del 64% rispetto ai moduli so-dimm convenzionali e migliorano l'efficienza energetica del 58%.

crucial sta attualmente producendo nuovi moduli con una capacità massima di 64 gb. questi moduli vengono in genere installati solo nei notebook pc preinstallati. secondo i funzionari dell'azienda, la società prevede di rilasciare soluzioni ancora più veloci (fino a 9600 mt/s) nel 2026.